中文语料库训练数据集

”中文语料库 维基百科 word2vec 训练词向量 最近“ 的搜索结果

使用gensim对维基百科作为预训练语料(约1.6G语料),生成词汇量约13000个词汇,维度为300,文件大小为45.6MB。使用方法,参考博客:https://blog.csdn.net/qq_36426650/article/details/87738919

维基百科简体中文语料训练word2vec词向量 步骤: 1.下载维基百科中文语料 2.使用工具从压缩包中抽取正文文本 3.将繁体字转简体字 4.分词 5.训练模型 6.测试模型 1.下载维基百科中文语料 语料下载地址:...

主要参考: ... https://www.kaggle.com/jeffd23/visualizing-word-vectors-with-t-sne 其他的可能还有一些,查阅的时候没注意,后来找不到了(⊙﹏⊙) ...本文使用的语料库是维基百科中文语料库截至2...

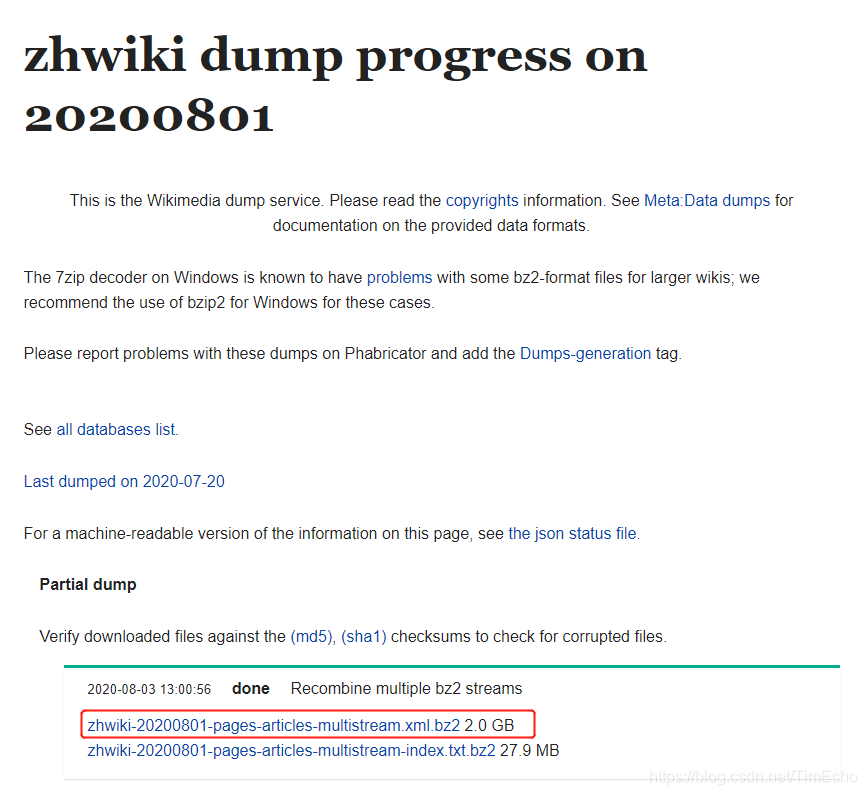

利用Wikipedia中文语料训练词向量一共分为两个篇章,这篇文章属于第一部分,包括下载Wikipedia语料库,并将其从繁体转换为简体。 目录第一步 下载语料库第二步 将下载好的bz2文件转换为txt(text)文件第三步 繁体转换...

这是最新的中文维基百科语料库(截至2019年2月20日),可以用来训练word2vec词向量,做文本分类,官网特别难下载,因此分享出来

训练结束后会产生三个模型文件wiki_zh.model、wiki_zh.model.wv.vectors.npy、wiki_zh.model.syn1neg.npy,找到其中的:opencc-1.0.1-win64,将wiki_zh.txt拷贝到该文件夹下,在opencc-1.0.1-win64文件夹下使用如下...

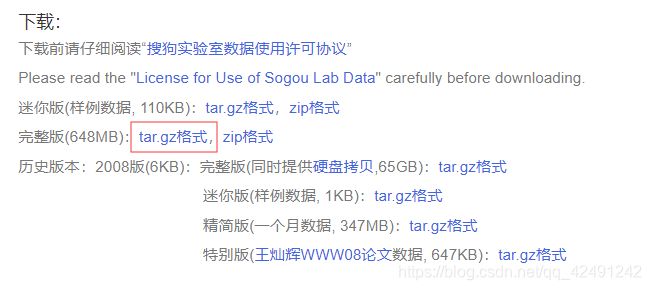

良好的词向量可以达到语义相近的词在词向量空间里聚集在一起,这对后续的文本分类,文本聚类等等操作提供了便利,这里简单介绍词向量的训练,主要是记录学习模型和词向量的保存及一些函数用法。 一、搜狐新闻 1. ...

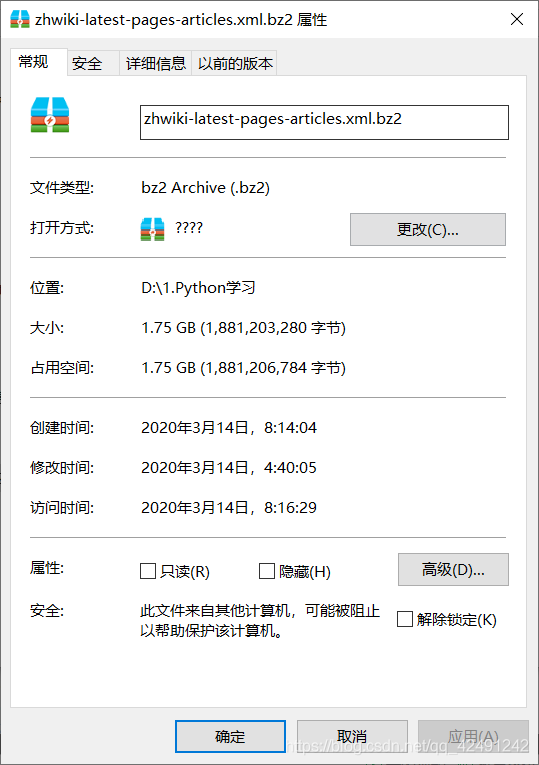

选取wiki中文语料,并使用python完成Word2vec模型,文件共14G,根据需要下载 原始语料库:zhwiki-latest-pages-articles.xml XML的Wiki数据转换为text格式:wiki.zh.txt 中文繁体转换为简体文件:wiki.zh.simp.txt ...

下载中文维基百科语料数据:wiki_data_1.4g 三、word2vec步骤: 1. 将xml的wiki数据转换成text数据 先将zhwiki-latest-pages-articles.xml.bz2文件复制到process.py所在目录下,cmd进入process.py文件所在目录,...

基于 word2vec 使用 wiki 中文语料库实现词向量训练模型

基于word2vec的中文词向量训练 一、引言 在绝大多数的自然语言处理任务中,语料是无法直接用来特征提取,需要将其转化为计算机可以读取的数值,因此引入独热编码,即对于语料库中为每一个词汇设置编号。在大语料...

前言自然语言处理有很多方法,最近很流行的是谷歌开源项目word2vec,详见谷歌官网:官网链接。其主要理论由Tomas Mikolov大神团队的2篇论文组成:Efficient Estimation of Word Representations in Vector Space, ...

参考:... 1.获取维基百科语料库资源 https://dumps.wikimedia.org/zhwiki/latest/zhwiki-latest-pages-articles.xml.bz2下载1.5G左右xml版本 2.抽取文件内容:从原始的xml文件中提取出标题和...

首先下载wiki中文语料(大约1.7G) https://dumps.wikimedia.org/zhwiki/latest/zhwiki-latest-pages-articles.xml.bz2 下载的文件名为“zhwiki-latest-pages-articles.xml.bz2” 这个大家都知道,然后没什么卵用,...

训练中文词向量word2vec模型1.准备数据中文维基百科地址:https://dumps.wikimedia.org/zhwiki/latest/zhwiki-latest-pages-articles.xml.bz2;搜狗全网新闻预料地址:http://www.sogou.com/labs/resource/ca.php;...

中文维基百科语料库 + word2vec 训练中文模型 1.准备数据 训练中文模型,中文预料数据是必须的,可以使用中文的维基百科,也可以是搜狗的新闻语料库。 中文维基百科地址:...

说明:由于在学习自然语言处理,读了很多篇博文,就想着动手实验一下,本文主要参考了中英文维基百科语料上的Word2Vec实验,其中在实验阶段出现了一些预期之外的错误,参考其他博文进行了微调。这篇博文更像是篇错误...

维基百科语料库:1.http://ftp.acc.umu.se/mirror/wikimedia.org/dumps/enwiki/20180320/2.https://meta.wikimedia.org/wiki/Mirroring_Wikimedia_project_XML_dumps3.https://dumps.wikimedia.org/生成词向量教程:...

2013年提出的word2vec的方法是一种非常方便得到高质量词向量的方式,其主要思想是:一个词的上下文可以很好的表达出词的语义,它是一种通过无监督的学习文本来用产生词向量的方式。word2vec中有两个非常经典的模型:...

1 对文本数据进行预处理:数据预处理,包括简繁体转换,去除xml符号,将单词条内容处理成单行数据,word2vec训练原理是基于词共现来训练词之间的语义联系的。不同词条内容需分开训练 2 中文分词:中文NLP很重要的...

环境: Win10 +Anaconda(自带Python3.6) IDE:&...Pycharm (其Interperter使用的是Anaconda自带的Python3.6)安装Gensim库:在Anaconda Prompt中输入:pip install gensim&nbsp...

在做文本情感分类的项目,研究到Word2Vec模型了。 自己来实践一下,网上大多数代码经过时间的流逝,多多少少都出了点小问题,为了方便自己之后的学术垃圾的制造,把自己跑出来的,修改过的代码和方法记录一下。 1....

推荐文章

- 游标_java游标查询。前面的查询会释放吗-程序员宅基地

- 从6大应用场景,看边缘计算落地生根_边缘站点应用-程序员宅基地

- JAVA—— HTML_java html-程序员宅基地

- ASP.NET版本简单的留言板的制作-程序员宅基地

- dnf时装预览怎么打开_您看我还有机会吗?被阉割的DNF时装市场系统-程序员宅基地

- Linux压缩解压tar.gz和zip包命令汇总_加压gz包命令-程序员宅基地

- c语言基础: L1-016 查验身份证_c语言检验身份照-程序员宅基地

- CI867AK01丨Modbus TCP接口模件丨3BSE092689R1-程序员宅基地

- PySide2入门--PySide2介绍与配置-程序员宅基地

- Jupyter Notebook如何调试?JupyterLab作为DeBug调试工具及调试教程_jupyterlab怎么debug-程序员宅基地